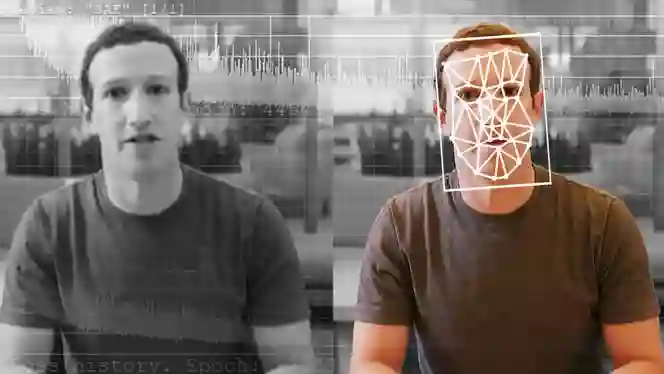

از هالیوود و واشنگتن تا جدول زمانی رسانههای اجتماعی و شبکه جهانی، "دیپ فیک" – یک کلمه مرکب از 'deep learning' و 'fake' – و سایر محتوای رسانهای مصنوعی که توسط هوش مصنوعی (AI) پشتیبانی میشود، بسیار سریعتر از آن که ما میتوانیم تصور کنیم، در حال افزایش است.

فقط در 2023، حداقل 95,820 ویدیوی دیپ فیک به انترنت درز کرده است.

بله، این ممکن جالب و سرگرم کننده باشد که ببینیم کیندریک لامار، رپر برنده جایزه پولیتزر در آهنگ 2022 خود "The Heart Part 5" به افرادی مانند کانیه، ویل اسمیت و نیپسی تبدیل میشود. اگر شما در میان آنهایی هستید که هنوز هم از پایان نمادین "بازی تاج و تخت" ناراضی هستند، شما حتی ممکن زمانیکه یک کلیپ جعلی جان اسنو را که برای فلمنامه فصل نهایی برنامه عذرخواهی میکند تماشا میکنید، یک نوع کاتارسیس را احساس کنید.

اما، اگر چنین دستکاری های هوش مصنوعی برای مقاصد مخربتر استفاده گردد چه اتفاق میافتد؟ معلومات و سروی ها نشان میدهد که بسیاری از مردم نمیتوانند دیپ فیکها را بطور قابل اعتبار متمایز سازند، درحالیکه برخی دیگر بعدا متوجه میشوند ویدئوهایی که در ابتداء واقعی پنداشته بودند، ساختگی هستند.

زمانیکه سخن از خطرات ایجاد شده توسط دیپ فیکها میشود، معلومات غلط سیاسی به ذهن میآید. با این حال، این تکنالوژی همچنان بشکل منظم برای آزار و اذیت و سوء استفاده از زنان، بشمول ستاره مشهور پاپ تیلور سویفت استفاده میشود. این موضوع نیز معلوم شد که حتی مشهور بودن و داشتن امتیازات نمیتوانست سویفت را از هدف محتوای پورنوگرافی که بدون رضایت بوجود آمده بود، نجات دهد.

صوفی توپین، دستیار پروفیسور در دیپارتمنت معلومات و ارتباطات در پوهنتون لاوال به TRT World گفت: متاسفانه، ما نباید از استفاده از دیپ فیک برای تحقیر زنان تعجب کنیم.

زمانیکه تصاویر جنسی دیپ فیک خواننده گروه آنتی-هرو در اواخر جنوری در رسانههای اجتماعی به سرعت پخش شد، طرفداران پرشور سویفت که به عنوان "سویفتی ها" شناخته می شدند، دست به عمل شدند. طرفداران، پلتفرم ایکس را با تصاویر مثبت سویفت پر کردند و حساب هایی که با محتوای دیپ فیک را به اشتراک میگذارند، ریپورت کردند. از اینرو، برچسب #ProtectTaylorSwift به ترند تبدیل شد.

به گفته توپین، این که طرفداران سویفت به این شیوه پاسخ میدهند از اهمیت اجتماعی و فرهنگی عالی برخوردار است. این طرز فکر به ایجاد نورم ها در مورد استفاده قابل قبول یا غیرقابل قبول رسانه های مصنوعی که توسط هوش مصنوعی تولید شده است کمک میکند – چه شما یکی از بزرگترین ستاره های پاپ در جهان باشید یا نباشید.

توپین میگوید: درحالیکه این عکس العمل سریع خیلی مؤفق است، باید قبول کنیم که هر کس چنین حمایت قوی در جامعه را ندارد. جامعه طرفداران تیلور سویفت یک مثال قابل توجه پاسخ فمینیستی را نشان داد که واضحاً گفته بود، 'این غیرقابل قبول است.' من امیدوارم که تمام زنان و دختران که در معرض چنین شیوه های تحقیر آمیز قرار دارند حمایت سریع مشابه را دریافت کنند. در حقیقت، چنین همبستگی در سطح جامعه دقیقاً همان چیزی است که ما باید به محتوای هوش مصنوعی جعلی زن ستیزانه و نژادپرستانه آنلاین "نه" بگوییم.

اگر بخواهیم به شکلی ساده توضیح دهیم، دیپ فایک یک نوع رسانه مصنوعی مبتنی بر صورت است که صورت و ظاهر یک شخص را با شخص دیگری در ویدیوها تغییر میدهد.

این رشته برای اولین بار در سال 2017 هنگامیکه یک استفاده کننده به نام جعلی "دیپ فیک" صورتهای مشاهیر را در اجسام زنان در فلم های بزرگسال جایگذاری کرد، با نشر محتوای بزرگسالان که بدون رضایت به صورت دیجیتالی تغییر یافته، سرعت گرفت.

این کاربر در صحبت خود از پروگرام وایس به مادربرد، گفت که از چندین کتابخانه منبع باز گوگل مانند TensorFlow بهره مند شده است، که میتواند به صورت رایگان برای ایجاد ویدیوها استفاده شود.

توپین توضیح می دهد: از یک دید تخنیکی، این مهم است که به یاد داشته باشیم که توانایی بسیاری از مردم برای ایجاد آسان دیپ فیک های تولید شده توسط هوش مصنوعی بر اساس امکانات فراهم شده توسط سافتویر موجود هوش مصنوعی است. این سافتویرها در مورد مقدار زیاد محتوا که ما منحیث استفاده کنندگان انترنت در جریان دو دهه گذشته تولید و به اشتراک گذاشته ایم آموزش دیده اند. این نیز موضوع مهمی است که باید در ذهن داشته باشیم.

در پی آنچه علیه سویفت اتفاق افتاد، قانونگذاران و شهروندان عادی خواستار محافظت قوی تر در برابر این تصاویر مبتنی بر هوش مصنوعی هستند که به سرعت و به طور هشدار دهنده از استرالیا تا اسپانیا در همه جا تکثیر می یابد و اغلب به زنان و کودکان آسیب می رساند.

اخیراً، جورجی پورسل، نماینده پارلمان ویکتوریا یک رسانه محلی را متهم کرد که با بزرگ کردن سینه هایش و آشکار ساختن لباسش، عکس او را تغییر داده است تا بدن او را بزرگتر از آنچه در واقع است، نشان دهد و این را به عنوان مثالی از تحقیر "مداوم و موذیانه" در برخورد با سیاستمداران زن در رسانه ها ذکر کرد.

جورجی پورسل، نماینده پارلمان ویکتوریا در حساب رسانه اجتماعی خود گفت: من دیروز چیزهای زیادی را تجربه کردم. اما فوتوشاپ کردن بدن و لباس های من توسط یک سازمان رسانه یی چیزی نبود که من توقع اش را داشتم. به سینه های من که بزرگتر به نظر میرسد و لباس من بدن نما تر شده است دقت کنید. آیا شما میتوانید تصور کنید که این برای یک نماینده مرد پارلمان اتفاق بیافتد؟ این دیگر چیست؟ — جورجیا پورسل (@georgievpurcell) 29 جنوری 2024.

بر اساس یک گزارش سال 2023، پورنوگرافی دیپ فیک 98 فیصد تمام ویدیوهای دیپ فیک که آنلاین یافت میشوند را تشکیل میدهد و 99 فیصد مردم که توسط پورنوگرافی دیپ فیک هدف قرار میگیرند زنان اند. این واضحاً نیاز به یک چارچوب تنظیمی بهتر را نشان میدهد.

توپین می گوید: بیایید فراموش نکنیم که اگر ما رسانه های مصنوعی ساخته شده بدون رضایت مردم را مصرف کنیم، بخشی از مشکل می شویم و این مهم است که بدانیم شما از خشونت دیجیتالی مبتنی بر جنسیت لذت می برید.

هرچند انقلابی باشد، عصر دیپ فیک ها چالش ها و نگرانی های جدیدی را برای قانونگذاران و دولت ها ایجاد می کند. تلاش برای تنظیم قوانین صحیح در خصوص این تکنالوژی را که میتواند هر کسی را در هر زمان وادار به گفتن هرچیزی بکند، برای قانونگذاران کار آسانی نیست.

به اساس راپورت 2022 توسط اداره همکاری اجرای قانون اتحادیه اروپا (یوروپول)، دسترسی فزاینده به اطلاعات نادرست و ویدیوها و تصاویر تولید شده توسط دیپ فیک "تأثیر عمیقی بر نحوه درک مردم از اقتدار و گزارش رسانه ها خواهد داشت" و همچنین اعتماد مردم به مقامات و معلومات رسمی را متزلزل خواهد کرد.

یوروپول در راپورت خود گفته است: کارشناسان نگران هستند که چنین وضعیتی ممکن است منجر به این شود که شهروندان دیگر واقعیت مشترک نداشته باشند و یا سردرگمی اجتماعی در مورد اینکه کدام منابع اطلاعاتی قابل اعتماد هستند، داشته باشند. این وضعیت گاهی "آخرالزمان اطلاعاتی" یا "بی تفاوتی نسبت به واقعیت" نامیده میشود.

برای سال های طولانی، مردم تلاش کرده اند تا هر معلومات را که میخوانند با مشوره کردن عکس ها و ویدیوها قبل از قبول کردن آن منحیث یک حقیقت قطعی تائید نمایند. مردم با این روش اساساً توصیه "تا زمانیکه ندیدهاید، باور نکنید" را دنبال میکردند.

با نزدیک شدن انتخابات ریاست جمهوری نوامبر، آخرین معلومات نشان میدهد که امریکایی ها در مورد استفاده هوش مصنوعی و دیپ فیک در مورد نامزد ها و شخصیت های سیاسی "بسیار نگران" هستند. بدون در نظر داشت حزب، اکثریت مطلق رأی دهندگان باور دارند که این تکنالوژی باید به درستی تنظیم گردد.

نگرانی های آنها بی اساس نیست. فقط ماه گذشته، در جنوری، یک تماس رباتیک جعلی که صدای تولید شده توسط هوش مصنوعی رئیس جمهور جو بایدن را تقلید میکرد به باشندگان نیو همپشیر گفت که به کاندید حزب دموکرات در انتخابات اولیه ایالت رای ندهند.

در سپتمبر 2023، والی فلوریدا، رون دی سانتیس هدف یک ویدیوی دیپ فیک وایرال بود که در آن انصراف خود را از رقابت ریاست جمهوری 2024 اعلام میکرد. حال اینکه، چند ماه قبل، تیم دی سانتیس یک ویدیوی دستکاری شده توسط هوش مصنوعی را از رئیس جمهور پیشین دونالد ترامپ و انتونی فوسی که یکدیگر را در آغوش گرفتند منتشر کرد.

چارلز کینگ، تحلیلگر صنعت تکنالوژی (Pund-IT) به فوربس گفت: ابزارها و سیستم های مورد نیاز برای تولید این نوع چیزها به آسانی در دسترس هستند. به همان اندازه مهم، اقلیم سیاسی فعلی در ایالات متحده چنان شکسته و زشت است که در هر دو طرف مخاطبان بزرگ و با اشتیاق وجود دارند که آماده و مایل به باور بدترین چیز در مورد طرف دیگر هستند.

در ژورنالیزم و کارهای تحقیقی، ضبط های صوتی و بصری، عکس ها و متون اغلب به عنوان شواهد قابل اعتماد نگریسته شده و کمک می کنند تا مشخص شود که چه چیزی واقعی است و چه چیزی جعلی. وسایل دستکاری دیجیتلی مانند فتوشاپ قبلاً وجود داشت، اما پنهان کردن آثار جعل اغلب اوقات نیاز به یک مقدار تخصص داشت. علاوه بر این، تصاویر اصلاح شده بدست آمده به اندازهای که تکنالوژی های هوش مصنوعی نشان داده است، پیشرفته نبودند.

زمانیکه هوش مصنوعی وارد عمل میشود، مخصوصاً در زمان درگیری و جنگ، احتمال پخش اطلاعات نادرست به طور تصاعدی افزایش می یابد. بنیانگذار پروژه GDELT (یک دیتابیس زمان واقعی رویدادها، زبان ها و صداهای جهانی)، داکتر کالیو هانس لیتارو این خطر را برجسته میسازد.

لیتارو که فعالیتهایش بر روی استفاده از تکنالوژی های پیشرفته و درک اینکه چگونه این تکنالوژی ها شکل جامعه جهانی را تغییر میدهد، تمرکز دارد، به TRT World گفت: احتمال استفاده بازیگران مخرب – چه غزه، اوکراین، یا ساحه دیگر درگیری باشد – از این ابزارها برای تولید اطلاعات بسیار شخصی و به طور گسترده جعلی در حال حاضر بسیار بالا است.

هر پلت فورم رسانه اجتماعی یا استفاده کننده مخرب میتواند به جمعیت تمام کشور نگاه کند، هر شخص یا گروه مردم را که میخواهد بر اساس تاریخچه رسانه اجتماعی شان هدف قرار داده و با علم بر اینکه این افراد چگونه به شدت عصبانی میشوند به آنها محتوایی را ارائه کرده و آنها را تحریک نموده در نتیجه جوامع را از هم گسیخته کند، و یا برعکس، زمانیکه اسناد واقعی جرایم جنگی از یک ساحه درگیری بیرون میاید، به آسانی میتواند آنها را تحت الشعاع قرار دهد.

در سال ۲۰۲۲ ویدیویی جعلی منتشر شد که در آن ولادیمیر زلنسکی، رییس جمهور اوکراین از سربازان خود خواست سلاح خود را علیه روسیه به زمین بگذارند. اما بسیاری از مردم نشانه های دستکاری دیجیتالی را بشکل درست شناسایی کردند – بطور مثال، زمانیکه صورت زلنسکی کاملاً با سر او مطابقت نداشت یا لهجه او عجیب به نظر میرسید.

اما، یک سال بعد، در ماه جون، رسانه های روسی به دام یک ویدیو جعلی مشابه اما قانع کننده تر رئیس جمهور روسیه، ولادیمیر پوتین افتادند. در دسمبر، دیپ فیکی که با هوش مصنوعی ساخته شده بود، رهبر روسیه را در حین برگزاری کنفرانس مطبوعاتی سالانه خود، با مشاهده تصویر جعلی خودش، شگفت زده کرد.

اسوشیتد پرس گزارش داده است که جنگ اسرائیل در غزه که در آن بیش از ۲۷ هزار و ۸۰۰ فلسطینی از هفتم اکتوبر کشته و بیش از ۶۷ هزار نفر زخمی شده اند، نیز ترس از قدرت فریبنده هوش مصنوعی را افزایش داده است.

فلم ها و شهادت های واقعی از منطقه که در حال حاضر تحت محاصره است وجود دارد، اما این ها بعضی اوقات با ادعاهای نادرست و حقایق تحریف شده در کنار هم قرار میگیرند. در اوایل جنگ، بعضی از تصاویر تولید شده توسط هوش مصنوعی در رسانه های اجتماعی دست به دست شد، بشمول یک عکس گریه کردن یک نوزاد در بین آوار. برعلاوه، عکس ها و ویدیوهای قدیمی از سایر مناطق درگیری به عنوان شواهد وضعیت فعلی در غزه ارائه شدند.

با گذشت زمان، هوش مصنوعی، همانطور که در مورد انیمیشن کمپیوتر یا نرم افزار ویرایش مانند فتوشاپ هم رخ داد، پیشرفته تر شده و به پیشرفت خود ادامه خواهد داد. امروزه، تقریباً هر کس میتواند با داخل کردن متن و یا با استفاده از ابزار هوش مصنوعی قابل دسترس مانند DALL-E یا Midjourney، تصاویر، ویدیو یا صوت تولید کند.

متخصصینی مانند لیتارو میگویند که وجود دیپ فیک ها میتواند مردم را در مورد اخبار واقعی یا تصاویر اصلی مشکوک سازد. حالا ما میتوانیم ناگهان محیط را با معلومات جعلی شناخته شده پر کنیم، و بعد بگوییم، 'تصویری که جنایات جنگی را مستند میسازد، آن هم مانند سایر اخبار، جعلی است.

به عبارت ساده، حقیقت اینکه شواهد قانع کننده که به صورت جعلی تولید شده، هشدار دهنده است و این موضوع همچنان به مردم اجازه میدهد تا شواهد واقعی را نادیده بگیرند، که این وضعیت اعتماد به تصاویر و ویدیوهای ضبط شده را به عنوان انعکاس واقعیت تضعیف میکند.

اندریاس کاپلان، مدیر و رئیس پوهنتون لوجستیک کوهن (KLU) در جرمنی و پروفیسور تغییر دیجیتالی، میگوید هیچ شک ندارد که محتوای تولید شده با کمک هوش مصنوعی – بشمول ویدیوهای دیپ فیک و تکنالوژیهای مشابه – در شکل دادن روایت ها، متاثر ساختن افکار عامه، و تقویت دیدگاه های معین نقش مهمی را بازی میکند.

اما، او تذکر میدهد که تاثیر این تکنالوژی بالای پخش معلومات نادرست قدرت کمتری دارد.

کاپلان به TRT World میگوید: به عبارت دیگر، هوش مصنوعی مولد، اساساً تولید اطلاعات نادرست و اطلاعات غلط را تسهیل می کند. اما، این امر تاثیر مشابه را بالای تقاضا یا پخش معلومات نادرست ندارد. کاپلان با اعلام اینکه مشکل واقعی این است که مردم شروع به اتکاء به ابزارهای هوش مصنوعی برای بدست آوردن اطلاعات کرده اند، علاوه میکند که این موضوع با قبول کردن معلومات در ویکیپدیا بدون هیچ پرسشی و یا باور کردن یا نکردن به یک تماس از سوی ماشین در جریان یک کمپاین سیاسی تفاوت چندانی ندارد.

اگرچه کاپلان اعتراف می کند که نهادهای تنظیمی به طور کلی از وضعیت کنونی عقب مانده اند، اما تاکید می کند که تلاش ها برای جلوگیری از سوء استفاده از محتوای رسانه یی ایجاد شده با هوش مصنوعی از جمله دیپ فیک ها ادامه دارد و می افزاید: یک مثال قابل توجه پیش نویس مقرراتی است که توسط کمیسیون اتحادیه اروپا برای هوش مصنوعی تهیه شده است. این مقررات نیاز به لیبل گذاری تمام محتوای تولید شده با تکنالوژی دیپ فیک دارد.

چیزی که کاپلان در مورد آن صحبت میکند قانون هوش مصنوعی است که در 9 دسمبر 2023 به یک توافق موقت رسید. این متن که برای اولین بار در اپریل 2021 پیشنهاد شد، باید رسماً توسط پارلمان و شورا تصویب شود تا به قانون اتحادیه اروپا تبدیل شود. پس از تأیید، اولین رهنمودهای جهان برای هوش مصنوعی را ایجاد خواهد کرد.

به همین ترتیب، ایالات متحده اخیراً تلاش های خود را برای تصویب قوانین برای مبارزه با دیپ فیک تشدید کرده است. این موضوع احتمالاً با نزدیک شدن انتخابات ریاست جمهوری نوامبر تسریع شد.

کانادا همچنان در حال بررسی یک لایحه است که شروع به تنظیم بعضی از سیستم های هوش مصنوعی خواهد کرد. در انگلستان، لایحه ایمنی آنلاین که در اکتوبر 2023 تصویب شد، در نظر دارد که کشور را با اتخاذ یک شیوه تحمل صفر برای محافظت از اطفال در برابر آسیب آنلاین از طریق قوانین جدید، به "امن ترین مکان در جهان آنلاین" تبدیل کند.

به گفته کاپلان، راه تشخیص اینکه آیا چیزی برای کاربر اوسط رسانه اجتماعی قابل اعتماد است یا خیر این است که به تولیداتی که مصرف میکنند با دقت نزدیک شوند و آنرا به صورت انتقادی ارزیابی کنند نه اینکه آنرا بدون پرسش بپذیرند.

کاپلان میگوید، این همچنان مهم است که تعصبات خود را بشناسید. بخاطریکه ما اغلب اوقات تمایل به باور کردن معلومات داریم که با پیش فرض های ما مطابقت دارد. این پروفیسور که علایق تحقیقی اش شامل هوش مصنوعی، دیجیتال سازی و پیشرفت ها در شبکه های اجتماعی است، میافزاید: دانستن این تعصب می تواند به تحلیل عینی تر اطلاعات کمک کند. وی در نهایت هشدار می دهد: به شکل خلاصه، هر چه خبر احساساتی تر به نظر برسد، ضرورت پرسش برای شناسایی منبع بیشتر است.