له هالیوډ او واشنګټن څخه د ټولنیزو رسنیو مهالویشونو او نړیوال ویب پورې، جعلي ویډیوګانې او انځورونه - د ژورې زده کړې او 'جعلي' ترکیب - نورې مصنوعي رسنۍ چې د مصنوعي ځيرکتيا (AI) سره رامینځته شوي په چټکۍ سره خپریږي تر هغه چې زموږ هر یو یې تصور کولی نشي.

یوازې په ۲۰۲۳ کال کې، لږ تر لږه ۹۵,۸۲۰ ژور جعلي ویډیوګانې وموندل شوې چې انټرنیټ ته یې لار موندلې وه.

هو، دا ممکن جالب او ساتیري وي چې کینډرک لامار په خپل ۲۰۲۲ سندره "The Heart Part ۵" کې چې پولیټزر جایزه یې ګټلې، د کانیې، وِل سمېت، او نیپسي په څېرو بدل شي. که تاسو د هغو کسانو له ډلې څخه یاست چې لا هم د "Game of Thrones" د وروستي فصل د کیسې په اړه ناخوښه یاست، کېدای شي د جون سنو د یوه جوړې شوې ویډیو بیا کتلو سره چې د دې فصل لپاره بښنه غواړي، یو ډول احساساتي تسکین تجربه کړئ.

خو څه پېښېږي کله چې د مصنوعي ځيرکتيا دا ډول بدلونونه د ناوړه موخو لپاره وکارول شي؟ معلومات او څيړنې ښيي چې زیاتره خلک د ژور جعلي کشف په پیژندلو کې باور نه لري، او ځینې خلک دا مني چې ویډیوګانې یې لیدلې چې په لومړي سر کې یې ریښتینې ګڼلې، خو وروسته ورته معلومه شوې چې جعلي وې.

په زیاتره وختونو کې، د ژور جعلي خطرونو رڼا د سیاسي نوعیت د غلطو معلوماتو په اړه وي. خو دا ټکنالوجي په دوامداره توګه د ښځو ځورولو او ناوړه ګټه اخیستنې لپاره کارول شوې، چې پکې د ټیلر سویفټ په څېر شخصیتونه هم شامل دي، چې د هغې امتیاز او د پاپ ستارې مقام یې دې ته ساتلی نه وه چې د غیر رضاکارانه فحش موادو ښکار شي.

" له بده مرغه، موږ باید حیران نه شو چې جعلي ويډيوګانې يا انځورونه د ښځو د ځورولو لپاره کارول کیږي," د لاوال پوهنتون د معلوماتو او اړیکو په څانګه کې مرستیال استاد سوفی ټوپین ټي آر ټي ورلډ ته وايي.

وروسته له دې چې د جنورۍ په وروستیو کې د انټي هیرو سندرغاړي جنسي څرګند ژور عکسونه په ټولنیزو رسنیو پلیټ فارمونو کې مشهور شول، د سویفټ زړه راښکونکي مينه وال، چې د سویفټیز په نوم پیژندل شوی، ژر عکسالعمل وښود. مینه والو په چټکۍ سره د سویفټ مثبتو عکسونو سره ایکس تیر کړ او هغه حسابونه یې راپور کړل چې جعلي ول، چې له دې سره #ProtectTaylorSwift هیشټاګ مشهور شو.

سوفي ټوپین وايي، د سویفټیز مبارزه لوی ټولنیزه او کلتوري اهمیت لري، ځکه چې دا د مصنوعي ځيرکتيا تولید شوي مصنوعي میډیا د منلو وړ او نه منلو وړ کارولو په اړه نورمونو رامینځته کولو کې مرسته کوي - که تاسو د نړۍ ترټولو لوی پاپ ستوري یاست یا نه.

ټوپین وايي, که څه هم دا چټک غبرګون خورا بریالی و، خو دا مهمه ده چې ومنو چې هر څوک داسې قوي ټولنیز ملاتړ ته لاسرسی نه لري. "د ټیلر سویفټ د مینوالو ټولنه د فېمینیسټ غبرګون یوه د پام وړ بېلګه وه چې په کلکه یې وویل، ‘دا د منلو وړ نه دی.’"

زه هیله لرم چې ټولې ښځې او نجونې چې د دې ډول ناوړه عمل سره مخ دي ورته چټک غبرګون وښيي. په حقیقت کې، د ټولنې په کچه، دا ډول پیوستون په حقیقت کې هغه څه دي چې د بدمرغۍ او توکمپالنې ژور جعلي ويډيوګانو يا انځورونو لخوا تولید شوي آنلاین منځپانګې ته نه ویلو اړتیا لري، "ټوپین زیاتوي.

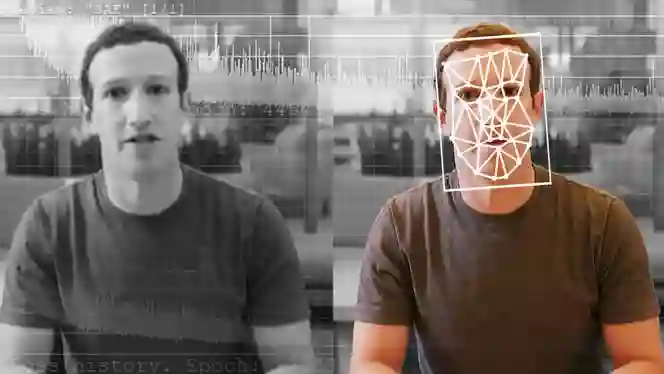

په ساده ټکو کې، ژورې جعلي ويډيوګانې يا انځورونه د مصنوعي میډیا یوه بڼه ده چې د مصنوعي ځيرکتيا په کارولو سره د یوه کس څېره او شکل په ویډیوګانو کې د بل کس سره بدلوي.

دا په پیل کې د ریډیټ یوه کارکوونکي لخوا چې د "ژور جعلي ويډيوګانو يا انځورونو" په مستعار نوم یادېده، پر مخ وړل شوه. هغه په ۲۰۱۷ کال کې د غیر رضاکارانه او ډیجیټلي بدل شوي بالغ مینځپانګې خپرول پیل کړل، چې پکې د مشهور شخصیتونو څېرې د بالغ فلمونو کې د ښځو پر بدنونو ایښودل شوې وې.

د وایس مدربورډ سره په خبرو کې، یاد کارکوونکي وویل چې دوی د ویډیوګانو جوړولو لپاره له ګڼو خلاصې سرچینې کتابتونونو ګټه اخیستې، چې پکې د ګوګل ټینسر فلو شامل دی، کوم چې د وړیا کارونې لپاره شتون لري.

په تخنیکي برخه کې، دا ډېر مهم دی چې په یاد ولرو چې ډیرو خلکو ته د مصنوعي ځيرکتيا په واسطه جوړ شوي ډیپ فېکونو جوړولو اسانتیا د موجوده مصنوعي ځيرکتيا جوړ شوي سافټویر پورې تړلې ده, ټوپین تشریح کوي. دا سافټویرونه په تېرو دوو لسیزو کې زموږ، د انټرنیټ کاروونکو، لخوا جوړ شوي او شریک شوي پراخ مینځپانګې باندې روزل شوي دي. دا یوه مهمه موضوع ده چې په یاد وساتل شي.

د سویفټ پېښې وروسته، قانون جوړونکو او عامو وګړو د مصنوعي ځيرکتيا لخوا رامینځته شوي عکسونو پروړاندې د قوي محافظت غوښتنه وکړه، کوم چې له آسټرالیا څخه تر هسپانیې او هرچیرې په خطرناکه او ګړندۍ کچه وده کوي، پداسې حال کې چې میرمنو او ماشومانو ته په پراخه کچه زیان رسوي.

وروسته، د ویکټوریا پارلمان غړې جورجي پرسیل یو ځايي خبري رسنۍ ته غبرګون وښود چې د هغې د بدن شکل یې داسې بدل کړی و چې د هغې سينه نيمه لوڅه ښکاره شي او د هغې د جامو ځینې برخې یې لرې کړې وې. هغې دې کار ته په رسنیو کې د ښځو د "پرلهپسې او ناوړه" چلند یوه بېلګه وبلله، په ځانګړي ډول په سیاست کې.

د ۲۰۲۳ کال د یوه راپور له مخې، جعلي لوڅ فلمونه د ټولو آنلاین ژور جعلي ويډيوګانو يا انځورونو ۹۸ سلنه جوړوي، او ۹۹ سلنه هغه کسان چې په ژور جعلي لوڅ فلمونو ويډيوګانو يا انځورونو کې هدف ګرځول شوي دي، ښځې دي. دا موضوع د ښه تنظیمي چوکاټ اړتیا په ډاګه کوي.

راځئ په یاد ولرو چې که موږ مصنوعي رسنۍ وکاروو چې د انځور شوي کس له رضایت پرته ترسره شوي وي، تاسو هم د ستونزې برخه یاست، توپین وايي. دا مهمه ده چې تاسو پوه شئ چې تاسو د جنسیت پر بنسټ ډیجیټل تاوتریخوالی څخه خوند اخلئ.

که څه هم د ژوره جعلي ويډيوګانو يا انځورونو دوره انقلابي ده، دا د قانون جوړونکو او حکومتونو لپاره نوې ننګونې او وېرې رامنځته کوي، کوم چې هڅه کوي دا ټکنالوژي په سمه توګه تنظیم کړي. دا ټکنالوژي دا وړتیا لري چې هر څوک په هر وخت کې داسې ښکاره کړي چې ګواکې یو څه وایي یا کوي.

د غلطو معلوماتو او ژورو معلوماتو مخ په زیاتیدونکي شتون، د ۲۰۲۲ کال د اروپايي اتحادیې د قانون پلي کولو همکارۍ ادارې په راپور کې ویل شوي، پر دې باندې ژور اغېز ولري چې خلک به واکمنۍ او د معلوماتو رسنۍ څنګه درک کوي، سربېره پر دې چې د چارواکو او رسمي حقایقو پر وړاندې باور کمزوری کوي.

کارپوهان ویره لري چې دا وضعیت ممکن هغه حالت ته ورسیږي چیرې چې وګړي نور ګډ واقعیت ونه لري، یا دا چې په ټولنه کې د باور وړ معلوماتي سرچینو په اړه ګډوډي رامنځته کړي؛ داسې حالت چې کله ناکله ورته د 'معلوماتي قیامت' یا 'واقعیت بې پروايي' ویل کیږي، د یوروپول په راپور کې راغلي.

د اوږدې مودې لپاره، خلکو عکسونو او ویډیوګانو ته مخه کوله ترڅو د هر ډول معلوماتو ملاتړ وکړي چې هغوی لوستل، مخکې له دې چې هغه د حقیقت په توګه په بشپړه توګه ومني؛ په اصل کې، د دې اصل پیروي کول "تر هغه چې یې ونه ګورئ، باور مه کوئ."

د ولسمشرۍ ټاکنې چې د نومبر لپاره پلان شوې دي، وروستي معلومات څرګندوي چې امریکایان د کاندیدانو او سیاسي شخصیتونو د مصنوعي ځیرکتیا او جعلي ټکنالوژۍ د کارونې په اړه "ډېر اندېښمن" دي. د ګوندونو ترمنځ رایه ورکوونکي اکثریت باور لري چې دا ټکنالوژي باید په سمه توګه تنظیم شي.

د دوی اندیښنه بې ځایه نه ده. یوازې تیرې جنورۍ میاشتې کې، یو جعلي روبوکال چې د ولسمشر جو بایډن د مصنوعي ځیرکتیا غږ په توګه ښکاره کېده، د نیو همپشایر اوسیدونکو څخه غوښتنه وکړه چې د ایالت په دیموکراتیک لومړنیو ټاکنو کې رایه ورنه کړي.

او په سپتمبر ۲۰۲۳ کې، د فلوریډا والی رون ډیسینټیس د یوې ویروسي ژور جعلي ویډیو هدف وګرځید، په کې اعلان شو چې هغه د ۲۰۲۴ کال د ولسمشرۍ ټاکنو څخه ځان بې برخې کوي، وروسته له دې چې هغه څو میاشتې مخکې د پخواني ولسمشر ډونالډ ټرمپ او انتوني فاوسي یوه مصنوعي ځیرکتیا سره جوړ شوې ویډیو خپره کړې وه چې یو بل ته غېږ ورکوي.

د ټکنالوجۍ صنعت کارپوه چارلس کینګ د Pund-IT فوربس ته وویل: د توکو تولید لپاره اړین وسایل او سیسټمونه په اسانۍ سره شتون لري. لکه څنګه چې مهمه خبره دا ده چې په متحده ایالاتو کې اوسنی سیاسي اقلیم دومره مات او بدمرغه دی چې لوی او چمتو دي. تر ټولو بدې خبرې د نورو په اړه باور وکړي.

په ژورنالیزم او تحقیقاتي کارونو کې، د انځورونو او متن تر څنګ غږیز او بصري ریکارډونه نه یوازې د باور وړ شواهدو په توګه ګڼل کیږي، بلکې د ژورنالیستانو او څیړونکو سره مرسته کوي چې معلومه کړي چې څه ریښتیا دي او څه ندي.

د ډیجیټل لاسوهنې نور ډولونه لکه فوټوشاپ شتون درلود مګر تاسو به معمولا د ترمیم نښې پټولو لپاره د یوې ځانګړې کچې تخصص ته اړتیا ولرئ. برسیره پردې، پایلې عموما هغومره پیچلې نه وې لکه څنګه چې د مصنوعي ځيرکتيا ټیک لخوا وړاندې شوي.

د مصنوعي ځیرکتیا په شتون کې، د غلطو معلوماتو امکان په بې سارې توګه زیاتېږي، په ځانګړې توګه په هغو وختونو کې چې جګړې او تنازعات رامنځته شي، د جی ډی ای ایل ټي پروژې بنسټ ایښودونکي ډاکټر کالیو هانس لیټارو وايي، چې د نړیوالو پیښو، ژبې او غږ د ریښتیني وخت ډیټابیس دی.

اوس مهال د بدو کړنو ترسره کوونکو لپاره ډیری امکانات شته — که دا د غزه په اړه وي، که د اوکراین په اړه، یا کومه بله شخړه وي— چې دا وسایل وکاروي تر څو هايپر-شخصي شوې، په پراخه کچه دروغ جوړ کړي، لیټارو چې د پرمختللو ټکنالوژیو د استفادې او د دې طریقو د پوهې په اړه کار کوي چې څنګه دا ټکنالوژۍ په نړیواله ټولنه بدله کړي، ټي آر ټي ته وویل.

تصور وکړئ چې یوه ټولنیزه رسنۍ [پلیټ فارم] یا بد کړنوال کولی شي د ټول هېواد د ټولو وګړو په اړه معلومات ترلاسه کړي، او بیا هر شخص هدف وګرځوي او هغه ته داسې څه ورکړي چې د هغوی د تاریخ پراساس پوهیږي چې دا به یې ډیر تحرک کړي او په ریښتینې توګه ټولنې له مینځه یوسي," هغه تشریح کوي، او زیاتوي، "یا برعکس، کله چې د جګړې د جنایتونو قانوني اسناد له یوې جګړه ځپلې سیمې څخه راڅرګند شي.

په ۲۰۲۲ کال کې، یوه جعلي ویډیو وښودله چې د اوکراین ولسمشر ولادیمیر زیلنسکي خپلو پوځیانو ته امر کوي چې د روسیې پر وړاندې وسلې وغورځوي، خو ډیرو کسانو په سمه توګه د ډیجیټل بدلون نښې وپیژندلې، پشمول د دې چې د هغه مخ د سر سره لږ بې نظمۍ ښودله او له هغه څخه د یوه غیره معمولۍ لهجه اوريدل کيده.

بل کال د جون په میاشت کې، څو روسي رسنۍ د روسیې د ولسمشر ولادیمیر پوتین د ورته جعلي مګر ډیر قانع کونکې ویډیو را ووتله. او د دسمبر په میاشت کې، د خپل ځان د مصنوعي ځیرکتیا جعلي ويډيو د روسیې ولسمشر حیران کړ پداسې حال کې چې هغه په کلنۍ خبري کنفرانس کې و.

لکه څنګه چې د اسوشیټېډ پرېس راپور ورکوي، د اسرائیلو جګړه په غزه کې، چې د اکتوبر پر ۷ نېټه د پوځي بریدونو پیل وروسته تر ۲۷،۸۰۰ زیات فلسطینیان وژلي او تر ۶۷،۰۰۰ زیات نور ټپيان شوي، همدارنګه د مصنوعي ځیرکتیا د غلطو معلوماتو خپرولو په اړه ویرې زیاتې کړي .

همدا اوس ، د محاصره شوي کلا څخه د وژلو ډیری ریښتیني عکسونه او حسابونه شتون لري ، مګر دوی کولی شي د دروغو ادعاوو او تحریف شوي حقیقتونو د مینځلو سره څرګند شي. د جګړې په پیل کې، د مصنوعي ځیرکتیا لخوا رامینځته شوي عکسونو، په شمول د یو ماشوم مشهورشوي انځور چې په کې یو ماشوم د بمباري په تباه شوو ځایونو کې ژاړي، په ټولنیزو رسنیو کې خپاره شول، پداسې حال کې چې د نورو جګړه ځپلو سیمو عکسونه او ویډیوګانې د دې ثبوت په توګه وړاندې شوې چې څه په غزه کې روان دي.

د وخت په تیریدو سره، مصنوعي ځیرکتیا یوازې پرمختګ کړی دی، او همداسې به دوام وکړي لکه څنګه چې د کمپیوټر انیمیشن یا ایډیټ کولو سافټویر لکه فوتوشاپ وکړل. نږدې هر څوک کولی شي یو اغېزمن جعلي شی جوړ کړي یوازې د دې لپاره چې متن په اسانۍ سره د مصنوعي ځیرکتیا جوړوونکو لکه ډال-ای یا میډجرني ته داخل کړي ترڅو انځورونه، ویډیو یا غږ تولید کړي.

ماهرین، لکه لیتارو وايي، یوازې دا حقیقت چې ژور جعلي شتون لري کولی شي خلک مغشوش کړي یا د دې لامل شي چې په ریښتیني خبرونو یا مستند عکس العمل شک وکړي. اوس تاسو ناڅاپه چاپیریال د پېژندل شوو غلطو معلوماتو سره ډکوي، نو تاسو کولی شئ ووایئ، هغه انځورونه چې د جګړې د جرمونو ښودنه کوي، یوازې جعلي خبرونه دي لکه څنګه چې دا نور شیان دي.

په ساده ډول، د اغېزمن جعلي شواهدو د جوړولو وړتیا اندېښمنونکې ده، او تر دې اضافه، دا خلکو ته اجازه ورکوي چې حقیقي شواهد رد کړي، چې د واقعیت د عکاسي شوي انځورونو او ویډیوګانو پر وړاندې باور زیانمنوي او د هغو د هدف منلو وړتیا کموي.

د جرمني د کیون لوژستیک پوهنتون رئیس او اجرائیوي مدیر، اندریاس کاپلان، چې د ډیجیټل بدلون پروفیسور هم دی، یادونه کوي چې هیڅ شک نشته چې د مصنوعي ځیرکتیا لخوا جوړ شوي موادو، په شمول د ژورو جعلي ویډیوګانو او ورته ټکنالوژیو، په روایتونو جوړولو، د عامه نظر اغېزمنولو، او ځانګړو لیدلورو په پراختیا کې مهم رول لوبوي.

خو هغه وایي چې د غلطو معلوماتو په خپرولو کې د دې اغېز په پراخه کچه کمزورې دی.

بل عبارت کې، د تولیدي مصنوعي ځیرکتیا اصلي کار دا دی چې د غلطو معلوماتو او ګمراه کونکو معلوماتو عرضه اسانه کړي، نه د دې غوښتنه یا د هغې وروسته خپرونه، کاپلان ټي آر ټي ته وایي، او زیاتوي چې اصلي ستونزه هغه وخت رامنځته کېږي کله چې خلک د معلوماتو لپاره په مصنوعي ځیرکتیا وسایلو تکیه وکړي، کوم چې د دې څخه په پراخه کچه توپیر نه لري چې معلومات په ویکیپېډیا کې د حقیقت په توګه ومنل شي یا د سیاسي کمپاین په جریان کې ترلاسه شوي روبوکالونو باور وشي.

سره له دې چې هغه مني چې د تنظیمي ادارو اقدامات اکثر د موجوده وضعیت څخه شاته پاتې دي، کاپلان په ګوته کوي چې لاهم هڅې روانې دي ترڅو د مصنوعي ځیرکتیا له لارې جوړ شوو رسنیزو موادو، په شمول د جعلي، ناوړه استفادې او غلط کارونې مخه ونیول شي. د پام وړ د اروپايي اتحادیې د کمیسیون هغه مسوده ده چې د مصنوعي ځیرکتیا په اړه یې د تنظیم لپاره چمتو کړې، چې په هغې کې د جعلي ټکنالوژۍ په کارولو سره جوړ شوي ټول موادو لپاره د نښو کولو غوښتنه کېږي.

کاپلان چې د کوم شي یادونه کوي هغه د مصنوعي ځیرکتیا قانون دی، چې د ۲۰۲۳ کال د دسمبر په ۹مه نېټه پرې لنډ مهاله موافقه ترلاسه شوه. دغه قانون چې لومړی ځل د ۲۰۲۱ کال په اپرېل کې وړاندیز شوی و، تصویب شوی متن به د اروپایي پارلمان او شورا له خوا په رسمي ډول منل کېږي ترڅو د اروپایي اتحادیې قانون وګرځي. یو ځل چې تصویب شي، دا قانون به د نړۍ د مصنوعي ځیرکتیا لومړنیو قوانینو لپاره لارښوونې وړاندې کړي.

په ورته ډول، متحده ایالاتو په دې وروستیو کې خپلې هڅې ګړندۍ کړې دي ترڅو داسې قوانین معرفي کړي چې هدف یې د ژوره جعلي ويډيوګانو يا انځورونو پر وړاندې مبارزه ده، چې دا ګام ښایي د راتلونکي نومبر د ولسمشرۍ ټاکنو د نږدې کېدو له امله اخیستل شوی وي.

کاناډا هم په یوه قانوني مسوده کار کوي چې ځینې د مصنوعي ځیرکتیا سیستمونه به تر تنظیم لاندې راولي. په ورته وخت کې، په بریتانیا کې د "آنلاین خوندیتوب قانون" چې په اکتوبر ۲۰۲۳ کې تصویب شو، هدف لري چې هېواد د نړۍ تر ټولو خوندي ځای وګرځوي ترڅو د ماشومانو د آنلاین زیان څخه د ساتنې لپاره د صفر زغم لرونکي نوو قوانینو له لارې اقدامات وکړي.

د اوسط ټولنیزو رسنیو کارونکي لپاره، د کاپلان په وینا، دا چې څه د باور وړ دي یا نه، ټاکل یې د دې معنا لري چې د هغه موادو په اړه احتیاط وکړئ چې تاسو یې کاروئ، او هغه په انتقادي توګه ارزونه وکړئ پر ځای د دې چې وړاندې شوي معلومات په ظاهري توګه ومنئ.

کاپلان وايي: همدارنګه دا هم مهمه ده چې خپل شخصي تمایلات وپېژنئ، ځکه چې موږ ډیری وختونه په هغه معلوماتو باور لرو چې زموږ د پخوانیو مفکورو سره سمون لري. د دې تمایل څخه خبرتیا کولای شي د معلوماتو په لا زیاتې عیني ارزونې کې مرسته وکړي, هغه پروفیسور زیاتوي چې د څېړنې ساحه یې د مصنوعي ځیرکتیا، ډیجیټل کېدو، او ټولنیزو شبکو پرمختګونه رانغاړي.

"د لنډیز په توګه، هرڅومره چې خبرونه حساس او پراخ ښکاري، هغومره یې د منبع پلټنه او څارنه مهمه کیږي."