ჰოლივუდიდან ვაშინგტონამდე, სოციალური მედიის თაიმლაინებიდან მსოფლიო ქსელამდე, ციფრულად გაყალბებული ვიდეოები - რომლებიც ხელოვნური ინტელექტის "ღრმა სწავლების" ტექნოლოგიით იქმნება - და სხვა ხელოვნური ინტელექტით შექმნილი მედია უფრო სწრაფად ვრცელდება, ვიდრე ოდესმე წარმოგვედგინა.

მხოლოდ 2023 წელს ინტერნეტში 95,820-ზე მეტი ხელოვნურად მანიპულირებული ვიდეო გავრცელდა.

რა თქმა უნდა, შეიძლება საინტერესო და გასართობი იყოს იმის ყურება, როგორ გარდაიქმნება კენდრიკ ლამარი კანიე უესტად, უილ სმიტად და ნიფსიდ პულიცერის პრემიის მფლობელი რეპერის 2022 წლის სინგლში "The Heart Part 5". შეიძლება კათარზისიც კი იგრძნოთ, როცა უყურებთ ჯონ სნოუს დამუშავებულ კლიპს, სადაც ის "სამეფო კარის თამაშების" ფინალური სეზონის სიუჟეტისთვის ბოდიშს იხდის, თუ იმათ შორის ხართ, ვინც (კვლავ) უკმაყოფილოა იმით, თუ როგორ დასრულდა ეს იკონური სერიალი.

მაგრამ რა ხდება, როცა ხელოვნური ინტელექტის ეს მანიპულაციები უფრო ბოროტი მიზნებისთვის გამოიყენება? მონაცემები და გამოკითხვები აჩვენებს, რომ ადამიანების უმეტესობას არ შეუძლია გაყალბებული ვიდეოების საიმედოდ ამოცნობა, ზოგიერთი კი აღიარებს, რომ უყურებდა ვიდეოებს, რომლებიც თავდაპირველად ნამდვილი ეგონა, მოგვიანებით კი აღმოაჩინა, რომ ყალბი იყო.

ძირითადად, გაყალბებული ვიდეოების საფრთხეების შესახებ ყურადღება, როგორც წესი, პოლიტიკური ხასიათის დეზინფორმაციაზე მახვილდება. თუმცა, ეს ტექნოლოგია მუდმივად გამოიყენება ქალების შევიწროებისა და შეურაცხყოფისთვის, მათ შორის ტეილორ სვიფტის წინააღმდეგაც, რომლის პრივილეგია და პოპ-ვარსკვლავის სტატუსი არ გამხდარა დაბრკოლება იმისთვის, რომ არაკონსენსუალური პორნოგრაფიული მასალის მსხვერპლი გამხდარიყო.

"სამწუხაროდ, არ უნდა გაგვიკვირდეს, რომ გაყალბებული ვიდეოები ქალების დასამცირებლად გამოიყენება," - აცხადებს ლავალის უნივერსიტეტის ინფორმაციისა და კომუნიკაციის დეპარტამენტის ასისტენტ-პროფესორი სოფი ტუპინი TRT World-თან საუბრისას.

ტუპინის თქმით, Swifties-ის წინააღმდეგობის ფორმას უდიდესი სოციალური და კულტურული მნიშვნელობა აქვს, რადგან ეს ხელს უწყობს ნორმების დამკვიდრებას იმის შესახებ, თუ რა არის მისაღები და მიუღებელი ხელოვნური ინტელექტით შექმნილი სინთეზური მედიის გამოყენებისას - მიუხედავად იმისა, ხართ თუ არა მსოფლიოს ერთ-ერთი უდიდესი პოპ-ვარსკვლავი.

"მიუხედავად იმისა, რომ ეს სწრაფი რეაგირება ძალიან წარმატებული იყო, მნიშვნელოვანია გვახსოვდეს, რომ ყველას არ აქვს წვდომა ასეთ ძლიერ საზოგადოებრივ მხარდაჭერაზე," - ამბობს ტუპინი. "ტეილორ სვიფტის ფანების საზოგადოება იყო ფემინისტური რეაგირების თვალსაჩინო მაგალითი, რომელმაც მტკიცედ განაცხადა: 'ეს მიუღებელია.'

"იმედი მაქვს, რომ ყველა ქალი და გოგონა, რომელიც ასეთი დამამცირებელი პრაქტიკის მსხვერპლი ხდება, ასეთივე სწრაფ რეაგირებას მიიღებს. ფაქტობრივად, საზოგადოებრივ დონეზე სწორედ ასეთი სოლიდარობაა საჭირო იმისთვის, რომ ვთქვათ უარი მიზოგინისტურ და რასისტულ ყალბ, ხელოვნური ინტელექტით შექმნილ ონლაინ კონტენტზე," - დასძენს ტუპინი.

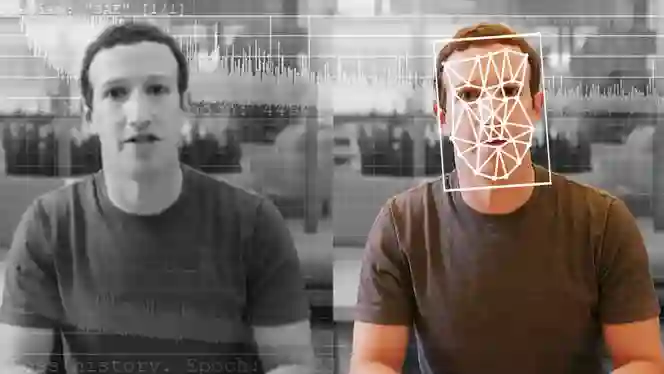

მარტივად რომ ავხსნათ, გაყალბებული ვიდეოები არის სინთეზური მედიის ფორმა, რომელიც ხელოვნურ ინტელექტს იყენებს ვიდეოებში ადამიანის სახისა და გარეგნობის სხვა ადამიანის სახით ჩასანაცვლებლად.

ეს ყველაფერი დაიწყო Reddit-ის მომხმარებლით, რომელიც ფსევდონიმით Deepfakes იყო ცნობილი. 2017 წელს მან დაიწყო არაკონსენსუალური და ციფრულად შეცვლილი პორნოგრაფიული კონტენტის გავრცელება, სადაც ცნობილი ადამიანების სახეები ზედადებული იყო პორნოგრაფიული ფილმების მსახიობების სხეულებზე.

Vice-ის Motherboard-თან საუბრისას, მომხმარებელმა განაცხადა, რომ ვიდეოების შესაქმნელად რამდენიმე ღია წყაროს ბიბლიოთეკა გამოიყენა, მათ შორის Google-ის TensorFlow, რომელიც უფასოდ არის ხელმისაწვდომი.

"ტექნიკური თვალსაზრისით, მნიშვნელოვანია გვახსოვდეს, რომ ბევრი ადამიანისთვის ხელოვნური ინტელექტით გაყალბებული ვიდეოების შექმნის სიმარტივე დამოკიდებულია ხელმისაწვდომ პროგრამულ უზრუნველყოფაზე," - განმარტავს ტუპინი. "ეს პროგრამული უზრუნველყოფა სწავლობდა იმ უზარმაზარი რაოდენობის კონტენტიდან, რომელიც ჩვენ, ინტერნეტის მომხმარებლებმა, ბოლო ორი ათწლეულის განმავლობაში შევქმენით და გავაზიარეთ. ეს მნიშვნელოვანი საკითხია, რომელიც უნდა გვახსოვდეს."

სვიფტის შემთხვევის შემდეგ, კანონმდებლებმა და რიგითმა მოქალაქეებმა მოითხოვეს უფრო მკაცრი დაცვა ხელოვნური ინტელექტით შექმნილი გამოსახულებების წინააღმდეგ, რომლებიც ავსტრალიიდან ესპანეთამდე და ყველგან შუალედში შემაშფოთებელი სისწრაფით მრავლდება და ძირითადად ქალებსა და ბავშვებს აზიანებს.

ცოტა ხნის წინ, ვიქტორიის პარლამენტის წევრმა ჯორჯი პერსელმა გააკრიტიკა ადგილობრივი მედია მისი სხეულის შეცვლისთვის, რომელმაც მისი მკერდი უფრო დიდი გახადა და ტანსაცმლის ნაწილი მოაშორა, უწოდა რა ამას პოლიტიკაში ქალების მიმართ მედიის მხრიდან "მიმდინარე, ფარული" მოპყრობის მაგალითი.

2023 წლის ერთი ანგარიშის თანახმად, პორნოგრაფიული გაყალბებული ვიდეოები შეადგენს ყველა გაყალბებული ვიდეოს 98 პროცენტს, ხოლო გაყალბებულ პორნოგრაფიაში სამიზნე პირების 99 პროცენტი ქალია, რაც ხაზს უსვამს უკეთესი მარეგულირებელი ჩარჩოს საჭიროებას.

"გვახსოვდეს, რომ თუ მოვიხმართ სინთეზურ მედიას, რომელიც გამოსახული პირის თანხმობის გარეშე შეიქმნა, თქვენც პრობლემის ნაწილი ხართ," - ამბობს ტუპინი. "მნიშვნელოვანია გესმოდეთ, რომ სიამოვნებას იღებთ გენდერულ ციფრულ ძალადობაზე."

რამდენად რევოლუციურიც არ უნდა იყოს, გაყალბებული ვიდეოების ეპოქა ახალ გამოწვევებსა და შიშებს უქმნის კანონმდებლებსა და მთავრობებს, რომლებიც ცდილობენ სათანადოდ დაარეგულირონ ეს ტექნოლოგია, რომელსაც შეუძლია ნებისმიერი ადამიანი აჩვენოს ნებისმიერი რამის მთქმელად ან გამკეთებლად ნებისმიერ დროს.

2022 წლის ევროკავშირის სამართალდაცვითი თანამშრომლობის სააგენტოს ანგარიშის თანახმად, დეზინფორმაციისა და გაყალბებული ვიდეოების მზარდი ხელმისაწვდომობა "ღრმა გავლენას მოახდენს იმაზე, თუ როგორ აღიქვამენ ადამიანები ხელისუფლებასა და საინფორმაციო მედიას," გარდა იმისა, რომ ძირს უთხრის ნდობას ხელისუფლებისა და ოფიციალური ფაქტების მიმართ.

"ექსპერტებს ეშინიათ, რომ ამან შეიძლება მიგვიყვანოს ისეთ სიტუაციამდე, სადაც მოქალაქეებს აღარ ექნებათ საერთო რეალობა, ან შეიძლება შექმნას საზოგადოებრივი დაბნეულობა იმის შესახებ, თუ რომელი საინფორმაციო წყაროებია სანდო; სიტუაცია, რომელსაც ზოგჯერ 'ინფორმაციულ აპოკალიფსს' ან 'რეალობის აპათიას' უწოდებენ," - ნათქვამია ევროპოლის ანგარიშში.

დიდი ხნის განმავლობაში ადამიანები ფოტოებსა და ვიდეოებს იყენებდნენ ნებისმიერი წაკითხული ინფორმაციის შესავსებად, სანამ რაიმეს ფაქტად მიიღებდნენ; ფაქტობრივად, ისინი მიჰყვებოდნენ რჩევას 'არ დაიჯერო, სანამ არ ნახავ'.

ნოემბერში დაგეგმილი საპრეზიდენტო არჩევნების წინ, უახლესი მონაცემები აჩვენებს, რომ ამერიკელები "ძალიან შეშფოთებულნი" არიან კანდიდატებისა და პოლიტიკური ფიგურების ხელოვნური ინტელექტითა და გაყალბებული ვიდეოებით გამოყენების გამო, ხოლო ამომრჩეველთა დიდი უმრავლესობა პარტიული კუთვნილების მიუხედავად მიიჩნევს, რომ ტექნოლოგია სათანადოდ უნდა დარეგულირდეს.

მათი შეშფოთება უსაფუძვლო არ არის. მხოლოდ იანვარში, ყალბი სატელეფონო ზარი, რომელიც პრეზიდენტ ბაიდენის ხელოვნურ ხმას იყენებდა, ნიუ-ჰემფშირის მცხოვრებლებს მოუწოდებდა არ მიეღოთ მონაწილეობა შტატის დემოკრატიულ პრაიმერში.

2023 წლის სექტემბერში კი ფლორიდის გუბერნატორი რონ დესანტისი გახდა ვირუსული გაყალბებული ვიდეოს სამიზნე, რომელშიც ის 2024 წლის საპრეზიდენტო არჩევნებიდან გამოსვლას აცხადებდა, მას შემდეგ, რაც რამდენიმე თვით ადრე გაავრცელა ყოფილი პრეზიდენტ ტრამპისა და ენტონი ფაუჩის ჩახუტების ამსახველი ხელოვნური ინტელექტით მანიპულირებული ვიდეო.

"ამ მასალის შესაქმნელად საჭირო ინსტრუმენტები და სისტემები ადვილად ხელმისაწვდომია," - განუცხადა Pund-IT-ის ტექნოლოგიური ინდუსტრიის ანალიტიკოსმა ჩარლზ კინგმა Forbes-ს. "რაც არანაკლებ მნიშვნელოვანია, აშშ-ში არსებული პოლიტიკური კლიმატი იმდენად დანაწევრებული და უშნოა, რომ ორივე მხარეს ჰყავს დიდი და მზად მყოფი აუდიტორია, რომელიც მზადაა დაიჯეროს ყველაზე ცუდი სხვების შესახებ."

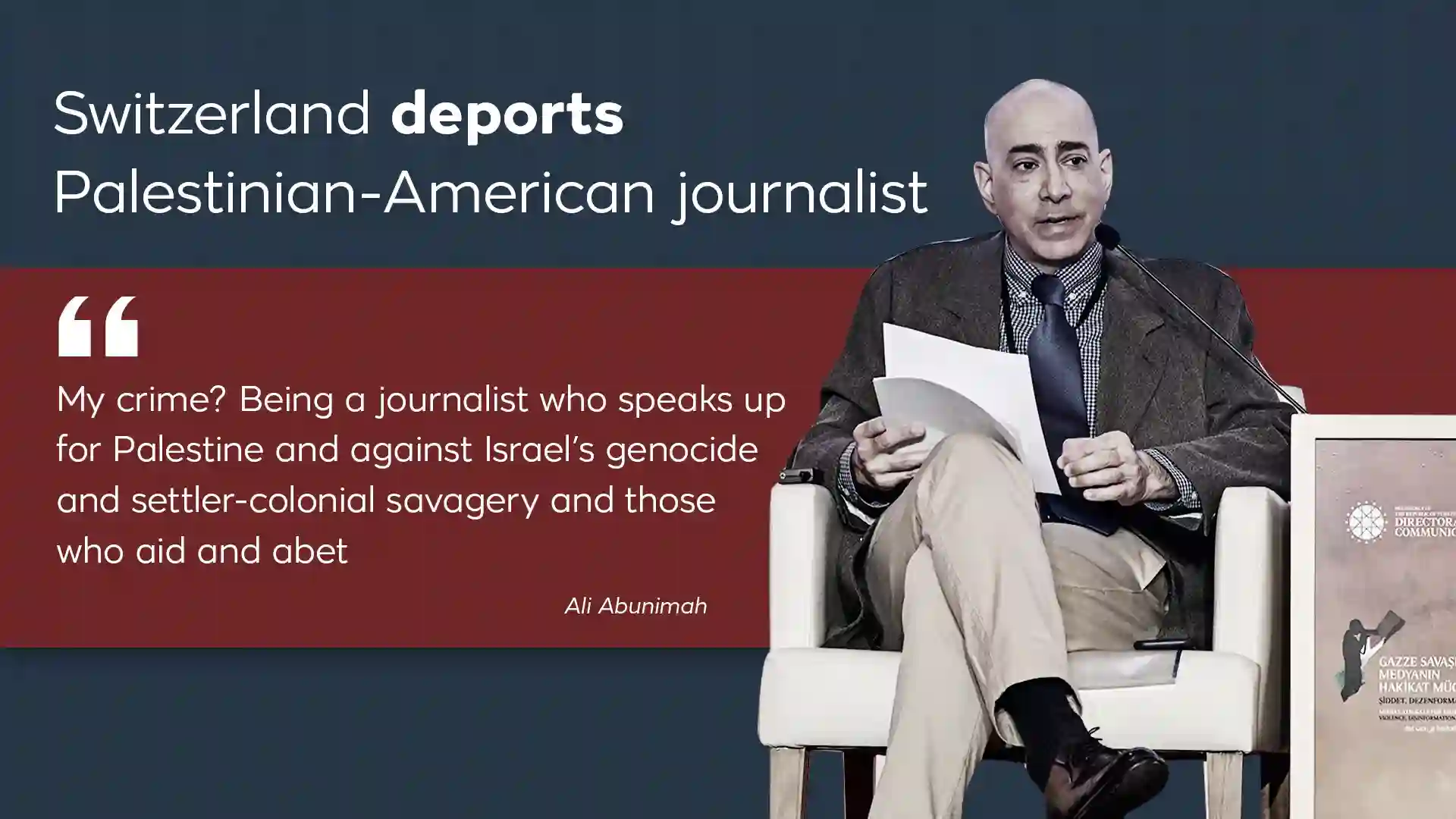

ჟურნალისტიკასა და საგამოძიებო საქმიანობაში აუდიო და ვიზუალური ჩანაწერები, ფოტოებთან და ტექსტთან ერთად, არა მხოლოდ სანდო მტკიცებულებად ითვლება, არამედ ეხმარება ჟურნალისტებსა და გამომძიებლებს დაადგინონ, რა არის რეალური და რა არა.

ციფრული მანიპულაციის სხვა ფორმები, როგორიცაა Photoshop, არსებობდა, მაგრამ ჩვეულებრივ გჭირდებოდათ გარკვეული დონის ექსპერტიზა რედაქტირების კვალის დასამალად. გარდა ამისა, შედეგები ზოგადად არ იყო ისეთი დახვეწილი, როგორც ხელოვნური ინტელექტის ტექნოლოგიით შექმნილი.

ხელოვნური ინტელექტის გამოჩენით, ყალბი ინფორმაციის გავრცელების შესაძლებლობა ექსპონენციურად იზრდება, განსაკუთრებით კონფლიქტებისა და ომის დროს, ამბობს GDELT პროექტის დამფუძნებელი დოქტორი კალევ ჰანეს ლეტარუ, რომელიც არის გლობალური მოვლენების, ენისა და ტონის რეალურ დროში მონაცემთა ბაზა.

"ამ მომენტში არის ბევრი პოტენციური საშიშროება ბოროტი განზრახვის მქონე პირებისგან - იქნება ეს ღაზასთან, უკრაინასთან თუ ნებისმიერ სხვა კონფლიქტთან დაკავშირებით - რომ გამოიყენონ ეს ინსტრუმენტები მასშტაბური, პერსონალიზებული სიყალბის შესაქმნელად," - ამბობს ლეტარუ, რომლის საქმიანობა მოიცავს მოწინავე ტექნოლოგიების გამოყენებასა და იმის გაგებას, თუ როგორ გარდაქმნიან ისინი გლობალურ საზოგადოებას.

"წარმოიდგინეთ სიტუაცია, სადაც სოციალური მედია პლატფორმა ან ბოროტი განზრახვის მქონე პირი გადახედავს მთელი ქვეყნის მოსახლეობას და მიზანში ამოიღებს თითოეულ ადამიანს, მიაწვდის მათ ისეთ რამეს, რაც, მათი ისტორიის მიხედვით, იციან, რომ ძალიან ააღელვებს და მართლა დაშლის საზოგადოებებს," - ხსნის ის და ამატებს, "ან პირიქით, როდესაც კონფლიქტის ზონიდან ომის დანაშაულების ლეგიტიმური დოკუმენტაცია გამოჩნდება."

2022 წელს გავრცელდა ყალბი ვიდეო, სადაც უკრაინის პრეზიდენტი ვოლოდიმირ ზელენსკი რუსეთის წინააღმდეგ იარაღის დაყრისკენ მოუწოდებდა თავის ჯარისკაცებს, თუმცა ბევრმა სწორად შეამჩნია ციფრული მანიპულაციის ნიშნები, მათ შორის ის, რომ მისი სახე ოდნავ აცდენილი იყო თავთან და აქცენტიც უცნაურად ჟღერდა.

მომდევნო წლის ივნისში რამდენიმე რუსული მედია წამოეგო მსგავს, მაგრამ უფრო დამაჯერებელ ყალბ ვიდეოს რუსეთის პრეზიდენტ ვლადიმირ პუტინთან დაკავშირებით. დეკემბერში კი ხელოვნური ინტელექტით შექმნილმა გაყალბებულმა ვიდეომ გააოცა რუსეთის პრეზიდენტი, როდესაც ის ყოველწლიურ პრესკონფერენციაზე იმყოფებოდა.

ისრაელის ომი ღაზაში, რომელმაც 7 ოქტომბრიდან დაწყებული სამხედრო თავდასხმების შემდეგ 27,800-ზე მეტი პალესტინელი იმსხვერპლა და 67,000-ზე მეტი დაჭრა, ასევე გაზარდა შიშები ხელოვნური ინტელექტის შეცდომაში შეყვანის ძალის შესახებ, იუწყება Associated Press.

ამ მომენტში ალყაშემორტყმული ანკლავიდან ბევრი რეალური გამოსახულება და ანგარიში მოდის, მაგრამ ისინი შეიძლება გამოჩნდეს ყალბი განცხადებებისა და დამახინჯებული სიმართლის ნაზავთან ერთად. ომის დასაწყისში, ხელოვნური ინტელექტით შექმნილი გამოსახულებები, მათ შორის ერთი ვირუსული სურათი მტირალი ჩვილისა დაბომბვის ნანგრევებში, გავრცელდა სოციალურ მედიაში, ხოლო სხვა კონფლიქტური ზონებიდან ფოტოები და ვიდეოები წარმოჩენილი იყო როგორც ღაზაში მიმდინარე მოვლენების უახლესი მტკიცებულება.

დროთა განმავლობაში ხელოვნური ინტელექტი მხოლოდ განაგრძობდა გაუმჯობესებას და ამას მომავალშიც გააკეთებს, ისევე როგორც კომპიუტერული ანიმაცია ან რედაქტირების პროგრამული უზრუნველყოფა, როგორიცაა Photoshop. თითქმის ნებისმიერს შეუძლია შექმნას დამაჯერებელი ყალბი მასალა ტექსტის შეყვანით ადვილად ხელმისაწვდომ ხელოვნური ინტელექტის გენერატორებში, როგორიცაა DALL-E ან Midjourney, რათა შექმნას გამოსახულებები, ვიდეო ან აუდიო.

ექსპერტები, როგორიცაა ლეტარუ, ამბობენ, რომ თავად გაყალბებული ვიდეოების არსებობის ფაქტმა შეიძლება დააბნიოს ან აიძულოს ადამიანები ეჭვი შეიტანონ რეალურ ახალ ამბებში ან ავთენტურ გამოსახულებებში. "ახლა უცებ გარემოს ავსებთ ცნობილი ყალბი ინფორმაციით, ასე რომ შეგიძლიათ თქვათ, 'აი, ის გამოსახულება, რომელიც ომის დანაშაულებს ასახავს, უბრალოდ ყალბი ამბავია, ისევე როგორც ეს სხვა მასალა.'"

მარტივად რომ ვთქვათ, დამაჯერებელი ყალბი მტკიცებულების შექმნის უნარი შემაშფოთებელია და ამასთან ერთად, ის საშუალებას აძლევს ადამიანებს უარყონ რეალური მტკიცებულება, რაც ძირს უთხრის ნდობას ჩაწერილი გამოსახულებებისა და ვიდეოების მიმართ, როგორც რეალობის ობიექტური ასახვის საშუალებების მიმართ.

კიუნეს ლოგისტიკის უნივერსიტეტის პრეზიდენტი და აღმასრულებელი დირექტორი ანდრეას კაპლანი, რომელიც ასევე არის ციფრული ტრანსფორმაციის პროფესორი, აღნიშნავს, რომ ეჭვგარეშეა, რომ ხელოვნური ინტელექტით შექმნილ კონტენტს, მათ შორის გაყალბებულ ვიდეოებსა და მსგავს ტექნოლოგიებს, მნიშვნელოვანი როლი აქვთ ნარატივების ფორმირებაში, საზოგადოებრივ აზრზე გავლენის მოხდენასა და კონკრეტული პერსპექტივების გაძლიერებაში.

თუმცა, მისი თქმით, მისი გავლენა ყალბი ინფორმაციის გავრცელებაზე გაცილებით ნაკლებია.

"სხვაგვარად რომ ვთქვათ, გენერაციული ხელოვნური ინტელექტი ძირითადად ამარტივებს დეზინფორმაციისა და მცდარი ინფორმაციის მიწოდებას და არა მასზე მოთხოვნას ან მის შემდგომ გავრცელებას," - ამბობს კაპლანი და დასძენს, რომ რეალური პრობლემა ჩნდება მაშინ, როდესაც ადამიანები ინფორმაციისთვის ხელოვნური ინტელექტის ინსტრუმენტებს ეყრდნობიან, რაც "არსებითად არ განსხვავდება ვიკიპედიაზე ინფორმაციის ფაქტად მიღებისგან ან პოლიტიკური კამპანიის დროს მიღებული რობოზარების დაჯერებისგან."

მიუხედავად იმისა, რომ ის აღიარებს, რომ მარეგულირებელი ორგანოები ხშირად ჩამორჩებიან მიმდინარე მდგომარეობას, კაპლანი ხაზს უსვამს, რომ მაინც კეთდება ძალისხმევა ხელოვნური ინტელექტით შექმნილი მედია კონტენტის, მათ შორის გაყალბებული ვიდეოების ბოროტად გამოყენების აღსაკვეთად. "აღსანიშნავია ევროკავშირის კომისიის ხელოვნური ინტელექტის რეგულირების პროექტი, რომელიც მოითხოვს გაყალბებული ტექნოლოგიით შექმნილი ყველა კონტენტის მარკირებას."

რაზეც კაპლანი საუბრობს, არის ხელოვნური ინტელექტის აქტი, რომელზეც წინასწარი შეთანხმება 2023 წლის 9 დეკემბერს მიიღწა. 2021 წლის აპრილში პირველად შეთავაზებული ტექსტი პარლამენტმა და საბჭომ ევროკავშირის კანონად ქცევისთვის ფორმალურად უნდა მიიღონ. დამტკიცების შემდეგ, აქტი უზრუნველყოფს სახელმძღვანელო პრინციპებს ხელოვნური ინტელექტის პირველი წესების შესახებ მსოფლიოში.

"მსგავსად ამისა, აშშ-მა ბოლო დროს გააძლიერა ძალისხმევა გაყალბებული ვიდეოების წინააღმდეგ საბრძოლველად კანონმდებლობის შემოსაღებად, რაც სავარაუდოდ გამოწვეულია ამ ნოემბერში დაგეგმილი საპრეზიდენტო არჩევნების მოახლოებით."

კანადა ასევე სწავლობს კანონპროექტს, რომელიც დაიწყებს ხელოვნური ინტელექტის ზოგიერთი სისტემის რეგულირებას. გაერთიანებულ სამეფოში კი ონლაინ უსაფრთხოების კანონი, რომელიც 2023 წლის ოქტომბერში მიიღეს, მიზნად ისახავს ქვეყანა გახადოს "მსოფლიოში ყველაზე უსაფრთხო ადგილი ონლაინ ყოფნისთვის" ახალი კანონების მეშვეობით, რომლებიც ნულოვანი ტოლერანტობის მიდგომას იღებენ ბავშვების ონლაინ ზიანისგან დასაცავად.

საშუალო სოციალური მედიის მომხმარებლისთვის, კაპლანის თქმით, იმის განსაზღვრა, არის თუ არა რაიმე სანდო, ნიშნავს სიფრთხილის გამოჩენას მოხმარებული მასალის მიმართ და მის კრიტიკულად შეფასებას, ნაცვლად იმისა, რომ მიიღო წარმოდგენილი ინფორმაცია პირდაპირ.

"ასევე მნიშვნელოვანია საკუთარი მიკერძოებების აღიარება, რადგან ხშირად გვაქვს ტენდენცია დავიჯეროთ ინფორმაცია, რომელიც ჩვენს წინასწარ შეხედულებებს ემთხვევა," - ამბობს კაპლანი.

სოციალური მედიის საშუალო მომხმარებლისთვის, კაპლანის აზრით, იმის დადგენა, არის თუ არა რაიმე სანდო, ნიშნავს იყო სიფრთხილე იმ მასალის მიმართ, რომელსაც მოიხმარ და მის კრიტიკულად შეფასებას, ვიდრე იმის მიღებას, რაც წარმოდგენილია ნომინალური ღირებულებით.

„ასევე მნიშვნელოვანია საკუთარი მიკერძოების აღიარება, რადგან ხშირად გვაქვს მიდრეკილება დავიჯეროთ ინფორმაცია, რომელიც შეესაბამება ჩვენს წინასწარგანწყობას“, - ამბობს კაპლანი. „ამ მიკერძოების ცოდნამ შეიძლება ხელი შეუწყოს ინფორმაციის უფრო ობიექტურ ანალიზს“, დასძენს პროფესორი, რომლის კვლევის სფერო მოიცავს AI-ს, დიგიტალიზაციასა და სოციალურ ქსელებში მიღწევებს.

”როგორ შევაჯამოთ, რაც უფრო სენსაციური ჩანს ახალი ამბები, მით უფრო კრიტიკული ხდება მისი წყაროს შესწავლა.”